Hubo un tiempo en el que hablar de inteligencia artificial era motivo de escepticismo, marcado por lo que se denominó como los «Inviernos de la IA». Estos periodos surgían cuando las grandes promesas no cumplían las expectativas, resultando en una disminución del interés y las inversiones. Este fenómeno provocaba una reacción en cadena que paralizaba los proyectos.

De aquellos tiempos, principalmente durante las décadas del 70 y 80 del siglo pasado, se aprendió que la sobreexpectación es peligrosa. Para avanzar en el campo de la inteligencia artificial, la clave era persistir, insistir y continuar incansablemente. Además, se entendió la importancia de proporcionar a los inversores señales claras de que el camino y la gran meta estaban al alcance.

Hoy, gracias a los notables avances en Modelos de Lenguaje (LLM) como GPT, la extrema competitividad y el impacto geopolítico de la IA, las expectativas son elevadas. Incluso se comparten fechas estimadas de cuándo podríamos alcanzar la Inteligencia Artificial General (AGI). No estamos hablando simplemente de modelos de lenguaje; ahora nos enfrentamos a modelos de inteligencia general, un desafío monumental en un momento en el que aún conocemos poco sobre el cerebro y la inteligencia humana.

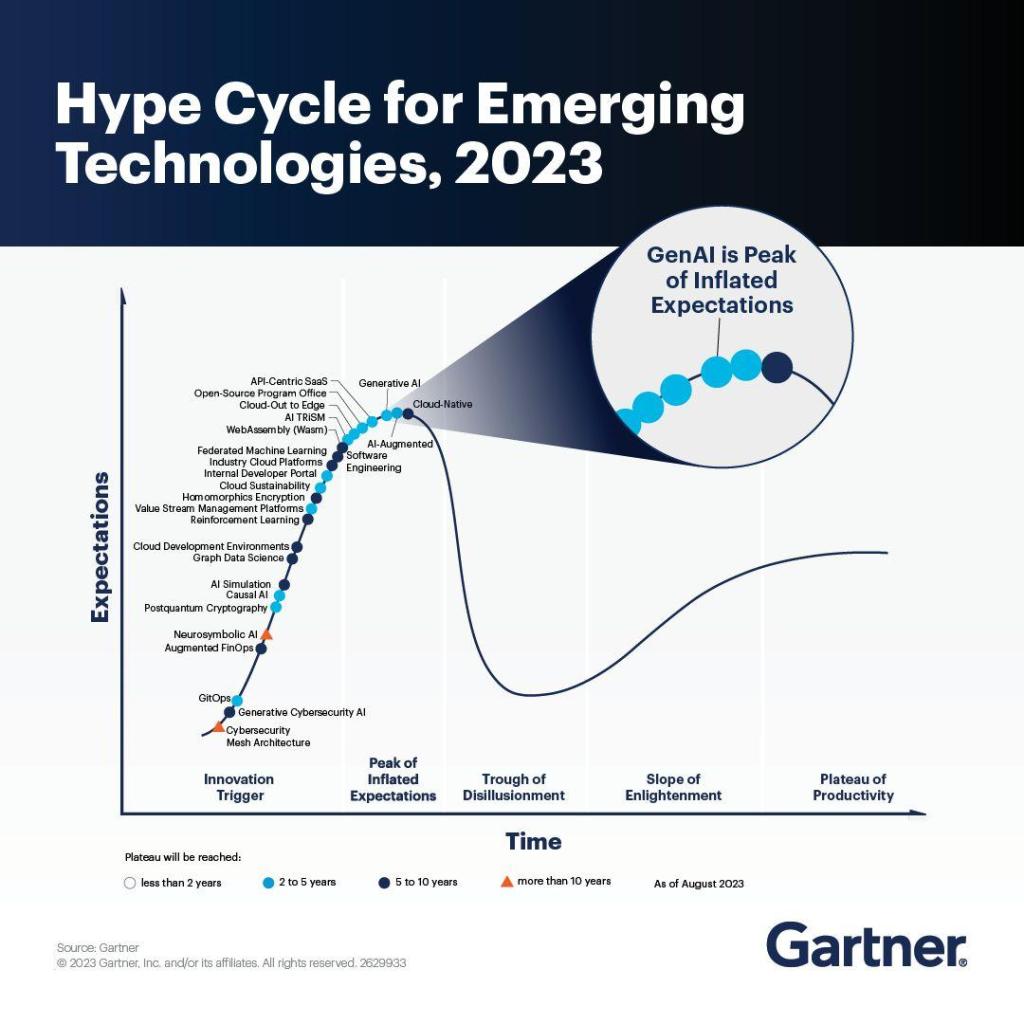

De hecho, como podemos ver en la gráfica de Gartner que acompaño abajo, en un momento en el que nos encontramos en el punto de máximo de inflación de expectativas, y a las puertas de un valle de desilusiones.

Llegado a este punto, estas reflexiones me llevan a recomendar dos libros que estoy explorando simultáneamente, cada uno provocador a su manera.

En primer lugar, «El Fin del Conocimiento» de David Vivancos, un fascinante libro que cuestiona lo que podría suceder si delegamos todo el conocimiento en las máquinas. Por otro lado, «Mil Cerebros: Una Nueva Teoría de la Inteligencia» de Jeff Hawkins, que explora teorías de la inteligencia con el objetivo de comprender cómo replicarla.

Ambos libros, en conjunto, me invitan a pensar en la inteligencia artificial más allá de ser simplemente un modelo del lenguaje y me hacen reflexionar sobre la posibilidad de un modelo general que abarque todo el conocimiento existente, utilizando un modelo de inteligencia artificial que emule nuestros algoritmos naturales.

La combinación de estas dos piezas, conocimiento y modelos generales, nos coloca frente a una pregunta trascendental que todos nos planteamos: ¿y ahora qué?

En este contexto, el desafío no es solo técnico sino también ético y filosófico. ¿Cómo equilibramos la delegación del conocimiento en las máquinas con la preservación de nuestra singularidad humana? ¿Cómo aseguramos que el progreso tecnológico se traduzca en beneficios para la sociedad en su conjunto?

A medida que exploramos estos territorios inexplorados, queda claro que estamos en un momento crucial, donde la reflexión y la acción serán fundamentales para guiar el desarrollo de la inteligencia artificial de manera ética y responsable. ¿Estamos preparados para enfrentar el desafío y determinar el curso de la inteligencia artificial en los años venideros? La respuesta está en la intersección de la innovación tecnológica y la sabiduría humana.

Puedes seguir el debate en Linkedin aquí